반응형

robots.txt 기본기|불필요 경로 차단과 크롤링 안내

검색엔진 크롤러는 먼저 robots.txt를 확인해 어떤 경로를 탐색(크롤링)할 수 있는지 판단합니다. 올바른 robots 정책은 불필요한 경로를 차단하고, 색인되어야 할 문서로 크롤 budget을 집중시킵니다. 이 글은 티스토리 블로그에 적용 가능한 허용·차단 패턴, 사이트맵 안내, 테스트·모니터링까지 주간 점검 루틴으로 정리합니다.

robots.txt 구조와 허용/차단 패턴

1) 기본 문법

# 모든 크롤러에 대한 기본 규칙

User-agent: *

Allow: /

# 사이트맵 위치 안내(권장)

Sitemap: https://example.com/sitemap.xml

User-agent는 규칙을 적용할 크롤러를 지정합니다. 다수의 User-agent 블록을 가질 수 있고, 각 블록 안에서 Allow/Disallow 경로를 나열합니다.

2) 패턴(와일드카드) 이해

*: 임의의 문자열(0자 이상)$: URL 끝 앵커(확장자 등)- 규칙 충돌 시: 보통 더 구체적인 규칙이 우선합니다.

# 내부 검색결과 차단 예(사이트마다 경로 상이)

User-agent: *

Disallow: /search

Disallow: /?s=

# PDF는 허용(예시)

Allow: /*.pdf$

블로그에서 자주 막는 경로(권장·주의)

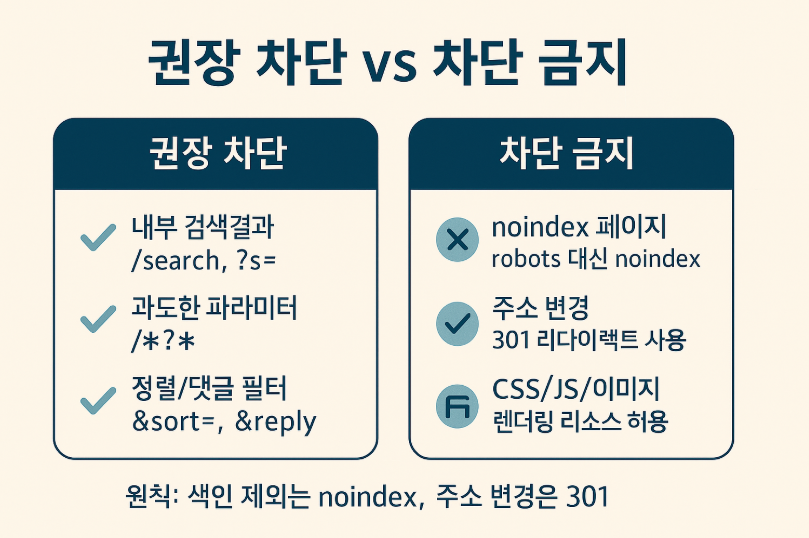

1) 권장 차단(중복·품질 저하 경로)

| 패턴 | 의미 | 비고 |

|---|---|---|

/search, /?s= |

내부 검색 결과 | 얇은/중복 페이지 |

/*?* |

과도한 파라미터 | 필요시 선택적으로 차단 |

/*&reply=, /*&sort= |

리스트 정렬/댓글 필터 | 색인 가치 낮음 |

2) 주의(robots로 막으면 안 되는 것들)

- 색인에서 빼고 싶다 →

noindex메타/헤더 사용이 원칙입니다(robots 차단은 “크롤 금지”일뿐 “색인 제거”가 아닙니다). - 콘텐츠 이전: 구 URL을 robots로 막기보다 301 리다이렉트가 우선입니다.

- 이미지·CSS·JS는 가능하면 허용해 렌더링을 방해하지 않도록 합니다.

사이트맵 안내와 테스트·모니터링

1) 사이트맵 연결

Sitemap: https://example.com/sitemap.xml

# 여러 개면 줄바꿈으로 추가

# Sitemap: https://example.com/page-sitemap.xml

사이트맵은 색인 후보 URL을 신속히 발견하게 도와줍니다. robots.txt의 위치는 https://도메인/robots.txt이며, 도메인 단위로 동작합니다.

2) 테스트·검증 루틴

- robots.txt 테스트: 제공 도구/텍스트 유효성 확인.

- URL 검사(라이브 테스트): 실제 차단 여부 확인.

- 커버리지: ‘차단됨(robots.txt에 의해)’ 변화 추적.

3) 티스토리 메모

- 플랫폼 기본 robots.txt가 제공됩니다. 사용자 정의가 제한적일 수 있어, 차단이 필요한 경우엔 내부 링크 설계, 메타 noindex(허용되는 페이지 유형)로 보완합니다.

- 커스텀 도메인이라도 웹서버에 직접 접근하지 못하면 robots.txt 자체 수정은 불가합니다.

복붙 템플릿·체크리스트

1) 최소 규칙 템플릿(복붙)

# robots.txt — 최소 안전안

User-agent: *

Allow: /

# 내부 검색·파라미터(사이트 상황에 맞춰 선택)

Disallow: /search

Disallow: /*?*

# 리소스는 허용(렌더링 보호)

Allow: /wp-content/uploads/

Allow: /*.css$

Allow: /*.js$

# 사이트맵

Sitemap: https://example.com/sitemap.xml

2) 주간 15분 체크리스트

- 차단 목록: 불필요 경로만 남아 있는가(남발 금지)

- 색인 제외: robots가 아니라 noindex/301로 처리했는가

- 사이트맵: 최신 글이 반영되는가(최근 가져오기 갱신)

- 커버리지: 'robots 차단' 급증 여부 확인

- 로그: (날짜/수정 항목/검증 결과) 기록실천 요약

- robots.txt는 크롤링 제한 도구입니다. 색인 제거는 noindex/301이 담당합니다.

- 차단은 최소화하고, 불필요 경로(검색결과·과도한 파라미터)만 막습니다.

- 반드시 사이트맵을 연결하고, 수정 후엔 URL 검사→커버리지로 검증합니다.

- 티스토리는 robots 커스텀이 제한될 수 있어 내부 링크·메타 정책으로 보완합니다.

최종 수정: 2025-11-24 · 문의: 댓글로 남겨주세요

반응형

'티스토리 활용법' 카테고리의 다른 글

| 내부 검색 최적화|검색창 배치와 결과 가독성 개선 (0) | 2025.11.25 |

|---|---|

| rel=canonical 적용 가이드|중복 URL 정리 시나리오 (0) | 2025.11.24 |

| 사이트맵 관리 체크리스트|발행·갱신·예외 처리 기준 (0) | 2025.11.23 |

| 서치 콘솔 핵심 활용|URL 검사·인덱스 커버리지 점검 루틴 (0) | 2025.11.23 |

| Q&A형 글 템플릿|검색 의도별 질문–답변 구조 표준 (0) | 2025.11.22 |